كتبت: منى حمدان

خداع البصر في عصر الذكاء الاصطناعي: دليلك لكشف الـ “Deepfake” قبل أن تقع في الفخ!

تخيل أنك تشاهد فيديو لصديقك المقرب يطلب منك سلفة مالية طارئة، أو ترى تصريحاً صادماً لسياسي مشهور يغير مجرى التاريخ، ثم تكتشف بعد دقائق أن كل ما رأيته “سراب رقمي”.

أهلاً بك في عصر الـ Deepfake أو “التزييف العميق”، حيث لم يعد مصطلح “رأيت ذلك بعيني” كافياً لإثبات الحقيقة.

في هذا التقرير، سنأخذك في رحلة استكشافية لنكشف لك “السحر الأسود” للذكاء الاصطناعي، ونمنحك نظارات رقمية تمكنك من كشف الزيف في ثوانٍ معدودة.

ما هو التزييف العميق؟ (عندما تتحدث الآلة بلسان البشر)

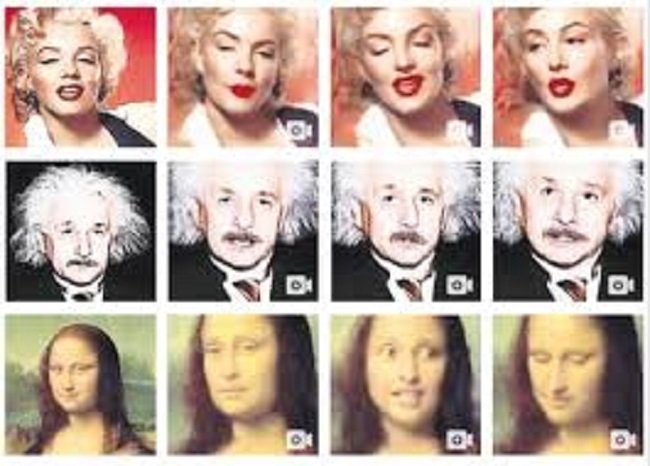

التزييف العميق هو تقنية تعتمد على “التعلم العميق” (Deep Learning) لدمج صور وفيديوهات لأشخاص حقيقيين فوق وجوه أخرى، لتبدو النتيجة مبهرة ومرعبة في آن واحد.

الأمر لم يعد مقتصرًا على استديوهات هوليوود، بل أصبح متاحاً لأي شخص يمتلك تطبيقاً بسيطاً على هاتفه.

خمس علامات “قاتلة” تفضح الفيديوهات المفبركة في ثوانٍ

لكي تكتشف التزييف، عليك أن تبحث عن “الأخطاء البشرية” التي تفشل الخوارزميات في محاكاتها بدقة حتى الآن:

-

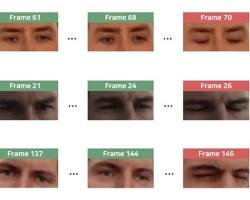

لغز “رمشة العين” المفقودة

البشر يرمشون بشكل طبيعي وتلقائي. في الفيديوهات المزيفة، غالباً ما تنسى الخوارزمية هذه التفاصيل الصغيرة، أو تكون الرمشة سريعة جداً أو بطيئة بشكل غير طبيعي.

إذا رأيت شخصاً يتحدث لمدة دقيقة دون أن يرمش.. فاحذر، أنت أمام روبوت!

-

حدود الوجه والظلال “المتمردة”

انظر جيداً إلى حواف الوجه، خاصة عند منطقة الأذنين والشعر. في الـ Deepfake، غالباً ما تظهر “هالات” أو غبش (Blur) بسيط عند الحدود.

كما أن الظلال داخل العينين أو خلف الرقبة قد لا تتطابق مع مصدر الضوء في الغرفة.

-

حركة الشفاه والأسنان “المثالية زيادة عن اللزوم”

هل تلاحظ أن الكلمات تسبق الشفاه بجزء من الثانية؟ أو أن الأسنان تبدو ككتلة واحدة بيضاء دون فواصل واضحة؟ الخوارزميات تجد صعوبة في رصد التفاصيل الدقيقة داخل الفم أثناء الحديث السريع، مما يخلق فجوة “رقمية” يمكنك رصدها بتركيز بسيط.

“النظرة الزجاجية” وتعبيرات الوجه

العين هي مرآة الروح، وهي أيضاً أكبر عدو للذكاء الاصطناعي.

في الصور المفبركة، تبدو النظرة “زجاجية” أو خالية من الحياة، ولا تتفاعل عضلات الوجه (مثل الجبهة أو الوجنتين) بشكل متسق مع المشاعر الظاهرة في الفيديو.

أدوات ذكية في جيبك لمحاربة التزييف

إذا خانك بصرك، فإليك هذه الأسلحة الرقمية التي ستنوب عنك:

- InVID: أداة جبارة يستخدمها الصحفيون لتقطيع الفيديو وتحليل كل إطار (Frame) على حدة.

- Deepware Scanner: موقع متخصص ترفع عليه الفيديو ليخبرك بنسبة احتمالية كونه “زيفاً عميقاً”.

- بحث الصور العكسي (Google Reverse Image Search): أحياناً يكون الحل بسيطاً؛ ابحث عن أصل الصورة، وستكتشف أنها مأخوذة من سياق مختلف تماماً.

لماذا يجب أن تهتم الآن؟ (خطر يتجاوز التسلية)

الأمر ليس مجرد “تريند” عابر، التزييف العميق يُستخدم اليوم في:

- الاحتيال المالي: انتحال شخصية مدير شركة لطلب تحويلات بنكية.

- التلاعب السياسي: نشر تصريحات كاذبة لإثارة الفتن.

- الابتزاز الشخصي: تشويه السمعة عبر تركيب الوجوه على مقاطع خادشة.

كيف تحمي نفسك من أن تكون “ضحية”؟

قاعدة ذهبية: “شكّك أولاً، ثم صدّق”.

قبل إعادة نشر أي فيديو صادم، اسأل نفسك: هل المصدر موثوق؟ هل توقيت النشر مريب؟ هل تبدو ملامح الشخص طبيعية؟

الوعي هو الدرع الأول.

- في عالم تصنعه الخوارزميات، تظل “الحاسة البشرية” هي الفلتر الأقوى.

- لا تسمح لعينيك بأن تخدع عقلك، وتذكر أن الحقيقة في عام 2026 أصبحت تحتاج إلى “تحقيق” وليس مجرد “مشاهدة”.